快捷键:

导入模块 例如导入matplotlib 方式:

–20201230

python不必加分号分行,但也可以不会报错

python的3种注释 1 “#”

###python数据类型不外传

arcpy的教程 点这里

判断网页是否为静态加载网页 ctrl+u 打开源代码,ctrl+f 打开搜索,可以搜索到结果,可以判定为静态加载

1 2 3 headers = {"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/88.0.4324.190 Safari/537.36"} response = requests.get(url=url,headers = headers) response.text

爬虫相关 [转载](https://mp.weixin.qq.com/s/U85Bnv4-WkSP-14qXBlDWg)

爬虫之Selenium模拟用户操作 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 #!/usr/bin/env python # -*- coding:utf-8 -*- from selenium import webdriver # 要想调用键盘按键操作需要引入keys包 from selenium.webdriver.common.keys import Keys #创建浏览器对象 driver = webdriver.Firefox() driver.get("http://www.baidu.com") #打印页面标题“百度一下你就知道” print driver.title #生成当前页面快照 driver.save_screenshot("baidu.png") # id="kw"是百度搜索框,输入字符串“微博”,跳转到搜索中国页面 driver.find_element_by_id("kw").send_keys(u"微博") # id="su"是百度搜索按钮,click() 是模拟点击 driver.find_element_by_id("su").click() # 获取新的页面快照 driver.save_screenshot(u"微博.png") # 打印网页渲染后的源代码 print driver.page_source # 获取当前页面Cookie print driver.get_cookies() # ctrl+a 全选输入框内容 driver.find_element_by_id("kw").send_keys(Keys.CONTROL,'a') # ctrl+x 剪切输入框内容 driver.find_element_by_id("kw").send_keys(Keys.CONTROL,'x') # 输入框重新输入内容 driver.find_element_by_id("kw").send_keys("test") # 模拟Enter回车键 driver.find_element_by_id("su").send_keys(Keys.RETURN) # 清除输入框内容 driver.find_element_by_id("kw").clear() # 生成新的页面快照 driver.save_screenshot("test.png") # 获取当前url print driver.current_url # 关闭当前页面,如果只有一个页面,会关闭浏览器 # driver.close() # 关闭浏览器 driver.quit()

实战:页面操作

1 <input type="text" name="user-name" id="passwd-id" />

1 寻找方法:

1 2 3 4 5 6 7 8 # 获取id标签值 element = driver.find_element_by_id("passwd-id") # 获取name标签值 element = driver.find_element_by_name("user-name") # 获取标签名值 element = driver.find_elements_by_tag_name("input") # 也可以通过XPath来匹配 element = driver.find_element_by_xpath("//input[@id='passwd-id']")

2 定位元素的方法

1 2 3 4 5 6 7 8 find_element_by_id find_elements_by_name find_elements_by_xpath find_elements_by_link_text find_elements_by_partial_link_text find_elements_by_tag_name find_elements_by_class_name find_elements_by_css_selector

3 鼠标动作

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 #!/usr/bin/env python # -*- coding:utf-8 -*- from selenium import webdriver # 要想调用键盘按键操作需要引入keys包 from selenium.webdriver.common.keys import Keys from selenium.webdriver import ActionChains #创建浏览器对象 driver = webdriver.Firefox() driver.get("http://www.baidu.com") #鼠标移动到某处 action1 = driver.find_element_by_id("su") ActionChains(driver).move_to_element(action1).perform() #鼠标移动到某处单击 action2 = driver.find_element_by_id("su") ActionChains(driver).move_to_element(action2).click(action2).perform() #鼠标移动到某处双击 action3 = driver.find_element_by_id("su") ActionChains(driver).move_to_element(action3).double_click(action3).perform() # 鼠标移动到某处右击 action4 = driver.find_element_by_id("su") ActionChains(driver).move_to_element(action4).context_click(action4).perform()

4 Select表单

1 2 3 4 5 6 7 8 9 10 # 导入 Select 类 from selenium.webdriver.support.ui import Select # 找到 name 的选项卡 select = Select(driver.find_element_by_name('status')) # select.select_by_index(1) select.select_by_value("0") select.select_by_visible_text(u"xxx")

以上是三种选择下拉框的方式,它可以根据索引来选择,可以根据值来选择,可以根据文字来选择。注意:

5 弹窗处理

1 alert = driver.switch_to_alert()

6 页面切换

1 driver.switch_to.window("this is window name")

7 页面前进和后退

1 2 driver.forward() #前进 driver.back() # 后退

页面级的网络爬虫 —1 requests 库获得一个请求回应

爬取网页中有用的信息时,通常是对存在于网页中的文本或各种不同标签属性值进行查找 —Beautiful Soup中内置了一些查找方式,最常用的是find()和find_all()函数

find_all —find_all( name , attrs , recursive , string , **kwargs )

pip install urllib2 失败问题

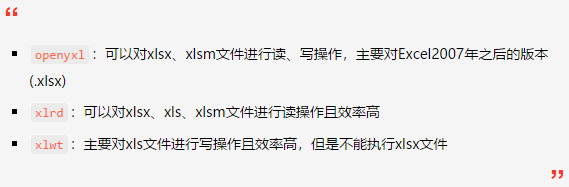

操作Excel的python库—xlrd与xlwt

类比于xlrd的reader,那么xlwt就相对于wtiter,而且很纯正的一点就是它只能对Excel进行写操作

安装与使用 1 2 pip install Xlrd pip install xlwt

(1)对齐

1 2 3 4 5 6 >>>print('{0:<20}'.format('python')) >>>print('{0:>20}'.format('python')) >>>print('{0:^20}'.format('python')) python python python

(2)千分分隔符

1 2 >>>print('{:,}'.format(123456789)) 123,456,789

(3)精度

1 2 3 4 5 6 >>>print('{0:.2}'.format(0.345)) >>>print('{0:.2f}'.format(12.345)) >>>print('{0:.4}'.format('python') 0.34 12.35 pyth

(4)进制转算

1 2 >>print('{0:b},{0:d},{0:o},{0:x}'.format(324)) 101000100,324,504,144